¿Puede la inteligencia artificial ayudar emocionalmente?

Una mirada desde la Psicoterapia Breve Estratégica

Cada vez más personas —adolescentes, jóvenes y adultos— recurren a la Inteligencia Artificial como ‘terapeuta de bolsillo’. Quiero creer que el motivo no es que hayan dejado de confiar en la psicoterapia, sino porque la IA responde siempre, valida continuamente y nunca confronta.

Precisamente ahí reside su mayor atractivo… y también, desde la lente clínica, su principal límite terapéutico.

Desde la Psicoterapia Breve Estratégica (PBE), la pregunta relevante no es si la IA “escucha”, sino qué tipo de solución representa su uso reiterado.

La IA como “solución intentada”

Uno de los aportes centrales de la Escuela de Palo Alto fue desplazar el foco del “porque” al cómo se mantiene el problema. Es decir, en cómo las personas intentan resolver su malestar… y en qué momento esas soluciones se convierten en parte del problema. Como plantea Watzlawick en el libro Change, sobre persistencia y cambio, el problema no es el problema; el problema es la solución (Watzlawick et al., 1974).

En PBE sabemos que los problemas, aparentemente irresolubles, persisten no por la causa original, sino por las soluciones intentadas, es decir, aquellas acciones o reacciones aplicadas para afrontar un problema que se repiten aun cuando no producen cambio.

Hablar con una IA cuando uno se siente mal puede ser, al principio, una solución funcional:

- Reduce la ansiedad momentáneamente

- Mantiene el autoengaño del control

- Evita la exposición emocional ante otra persona

- Permite hablar sin consecuencias aparentes

Desde un punto de vista táctico, esto explica por qué su uso se refuerza. Desde un punto de vista estratégico, explica por qué puede cronificar el malestar. Una solución inicial que alivia a corto plazo pero después el desasosiego vuelve a presentarse, si se reitera en el tiempo, puede cronificar a largo plazo.

La literatura científica reciente sugiere que los agentes conversacionales basados en IA pueden producir mejoras leves en el bienestar emocional, pero no reemplazan la psicoterapia estructurada (Li et al., 2023). La IA alivia, pero no transforma, mantiene la situación igual.

En este sentido, el uso reiterado de la inteligencia artificial como apoyo emocional puede entenderse como una solución intentada contemporánea, eficaz en la reducción inmediata del malestar, pero limitada en su capacidad para generar cambio psicológico estable.

¿Por qué la IA parece “entender” tan bien?

Porque reproduce patrones lingüísticos -algoritmos- de validación emocional, no porque comprenda emociones.

La IA ratifica, reformula y tranquiliza. Y eso, para alguien que está sufriendo un estado de malestar, suele ser suficiente para generar alivio… al menos al principio.

Sin embargo, como señaló Watzlawick en El lenguaje del cambio, comprender no equivale a cambiar. El cambio terapéutico, para el modelo estratégico, no se produce por acumulación de explicaciones, sino por modificación de las retroacciones redundantes que mantienen el problema. La psicoterapia no opera solo a nivel explicativo, cognitivo, sino experiencial y estratégico.

La IA como mecanismo de alivio:

- Reproduce patrones de validación (“Te entiendo, es normal que te sientas así”).

- Opera en el mismo nivel lógico del problema, ratificando la narrativa del usuario.

- Reduce la activación emocional, alimentando la homeostasis disfuncional.

La PBE como mecanismo de cambio:

- Introduce la reestructuración y la confrontación estratégica.

- Opera en un meta-nivel (Niveles Lógicos de Russell), cuestionando las premisas del problema.

- Busca la experiencia emocional correctiva que interrumpa el patrón alimentado por intentos fallidos, aunque inicialmente genere incomodidad.

- Modifica el sistema perceptivo-reactivo instaurando una homeostasis funcional.

No es una diferencia técnica, sino epistemológica. En otras palabras: la IA no hace intervención clínica.

El riesgo invisible: cuando hablar se convierte en evitar

En la práctica clínica observamos con frecuencia un perfil recurrente:

personas capaces de hablar mucho de lo que sienten, pero incapaces de hacer algo diferente que les permita salir de los mismos patrones invalidantes.

La IA puede reforzar este fenómeno:

- Se habla, pero no se cambia.

- Se desahoga, pero no se evoluciona.

- Se entiende, pero no se desbloquea.

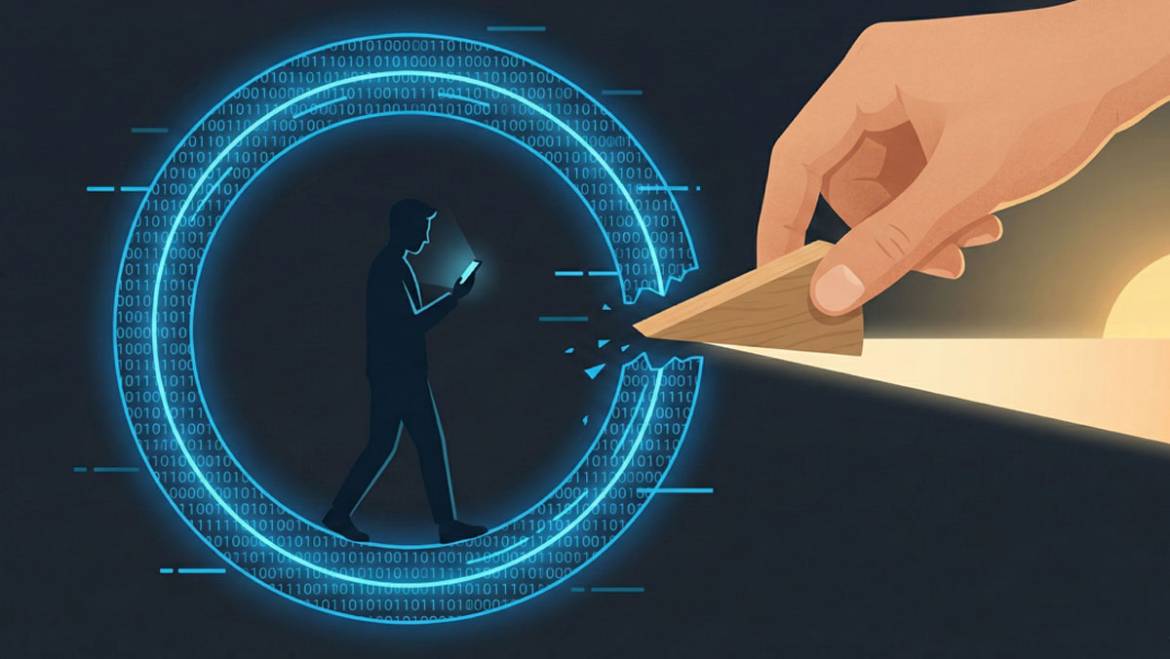

En términos estratégicos, el riesgo no es la tecnología, sino que la persona quede atrapada en una homeostasis emocional cómoda pero disfuncional, una homeostasis donde todo cambia para que nada cambie. Desde esta perspectiva, la IA no genera el problema, pero puede mantenerlo.

Desde la literatura ética y clínica se advierte, además, que la confusión entre apoyo automatizado e intervención psicoterapéutica puede generar falsas expectativas y retrasar la búsqueda de ayuda profesional adecuada (Fiske et al., 2019).

IA y adolescentes: una cuestión de función, no de moral

En adolescentes y jóvenes, la IA puede cumplir una función inicial:

- Facilitar la expresión emocional

- Introducir vocabulario psicológico

- Ofrecer un espacio sin juicio

- Reducir la sensación de soledad

El problema aparece cuando la relación se sustituye por el diálogo automático de la IA.

Desde la PBE sabemos que el cambio psicológico ocurre en interacción real, no en simulación relacional. Ningún algoritmo puede producir una experiencia emocional correctiva, experiencia clave para revertir el circulo vicioso en un círculo virtuoso.

IA vs. psicoterapia: una falsa dicotomía

No se trata de elegir entre IA o psicoterapia.

Se trata de no confundir niveles lógicos de intervención, parafraseando a Bertrand Russell. La intervención de la IA se mantiene en el mismo nivel lógico que el discurso del usuario, pero no actúa en un meta-nivel experiencial, nivel donde opera la psicoterapia.

La inteligencia artificial puede:

- acompañar momentáneamente

- informar

- aportar psicoeducación

- servir como contención puntual

La psicoterapia breve estratégica puede:

- identificar soluciones intentadas

- diseñar intervenciones ad hoc

- generar experiencias emocionales correctivas

- provocar cambios rápidos y observables

- asumir responsabilidad clínica y ética

O, dicho de forma más clara:

la IA conversa y tranquiliza; la psicoterapia estratégica interviene para que ocurra el cambio.

Una nota clínica final

Cuando una persona consulta porque “hablo mucho con una IA, pero sigo igual”, no estamos ante un fallo tecnológico, sino ante una solución intentada, una solución que ya ha mostrado su límite y eficacia. Como ya indicaba Watzlawick, cuando una solución se repite sin producir cambio, deja de ser solución y pasa a formar parte del problema.

Y eso, desde la Psicoterapia Breve Estratégica, es precisamente el punto de palanca para el cambio, el punto donde la intervención terapéutica se vuelve posible.

Conclusión

La inteligencia artificial puede escuchar.

Pero escuchar no siempre implica intervenir.

E intervenir no siempre es tranquilizar.

A veces, el verdadero alivio no viene de una respuesta “empática”, sino de una intervención que interrumpa el círculo vicioso en el que la persona lleva tiempo girando, como el hámster en su rueda.

La Psicoterapia Breve Estratégica recuerda algo esencial en tiempos de tecnología avanzada: no todo lo que alivia, cura; y no todo lo que cura, alivia al principio.

Como terapeutas, nuestro reto hoy no es competir con la capacidad de procesamiento o la “empatía sintética” de un algoritmo, sino dominar el arte de la interrupción estratégica de los patrones disfuncionales. La próxima vez que evaluemos las soluciones intentadas de un paciente, posiblemente debamos incluir a ChatGPT en la lista.